Die Schriftsteller George Orwell und Aldous Huxley sind vor mehr als einem halben Jahrhundert gestorben. Wer am vergangenen Sonntag die New York Times (NYT) aufschlug, konnte einen anderen Eindruck bekommen. "Gesichtsscan-App bringt das Ende der Privatsphäre näher", stand dort auf der Titelseite. Was folgte, erinnerte an eine Mischung aus "1984" und "Schöne neue Welt".

Die Zeitung druckte aber keine dystopische Science-Fiction-Literatur, sondern eine Recherche der Journalistin Kashmir Hill. Sie deckt auf, wie das bis dato unbekannte US-Unternehmen Clearview eine gewaltige Datenbank mit Fotos von menschlichen Gesichtern aufgebaut hat. Der Bericht hat politische Reaktionen ausgelöst, wirft juristische Fragen auf und zeigt, warum Datenschützer seit Jahren vor automatisierter Gesichtserkennung warnen. Die wichtigsten Antworten im Überblick:

Wie arbeitet Clearview?

Glaubt man der PR des Unternehmens, hat Clearview mehr als drei Milliarden Fotos aus öffentlich zugänglichen Quellen abgesaugt. Das funktioniert mit Hilfe sogenannter Scraper - Software, die automatisch Bilder herunterlädt, die nicht auf "privat" gestellt werden. Die Scraper zapfen Plattformen wie Facebook, Instagram, Youtube und Twitter an, bedienen sich aber auch an Nachrichtenportalen oder Webseiten von Arbeitgebern, die Fotos ihrer Angestellten veröffentlichen.

Der Albtraum für die Privatsphäre: Das Programm "Clearview AI" kennt die Gesichter von Millionen Menschen. US-Polizisten setzen sie bereits ein.

Wie funktioniert die Gesichtserkennung?

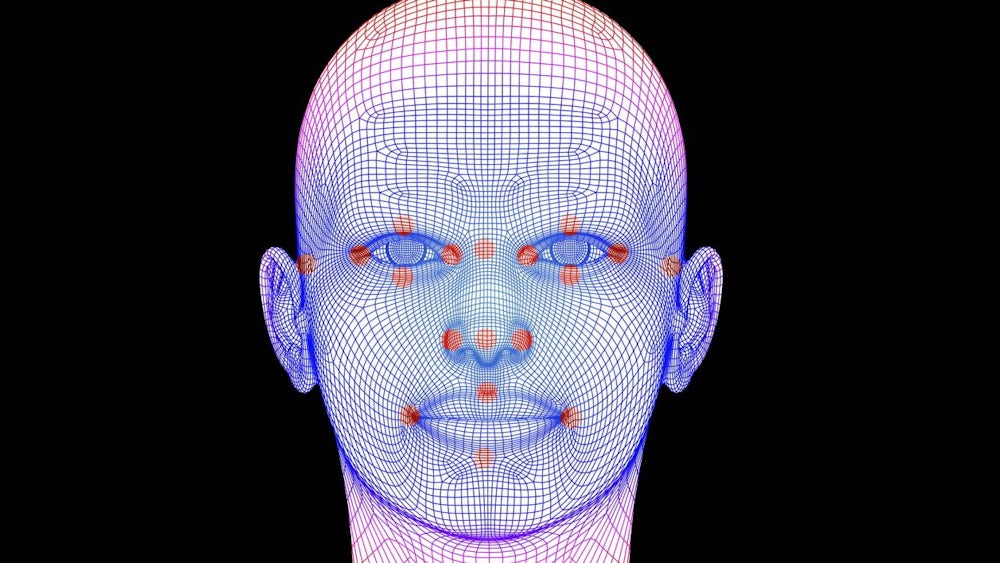

Die technischen Details der Software sind unklar. Gründer Hoan Ton-That sagt, Clearview nutze ein übliches biometrisches Verfahren. Demnach analysiert ein künstliches neuronales Netz, dessen Aufbau den Schichten des menschlichen Gehirns ähnelt, die vorliegenden Fotos. Es übersetzt die optischen Merkmale des Gesichts in Vektorgrafiken und erstellt ein mathematisches Modell, das von Maschinen gelesen werden kann. Mit Hilfe dieses Rasters gleicht die Software neue Bilder mit der Datenbank ab. Wer das System mit dem Foto eines unbekannten Gesichts füttert, dem spuckt es ähnliche Bilder aus, und man erfährt, an welchen Stellen im Netz diese Funde aufgetaucht sind.

Ist Clearview mehr als ein Hype?

2018 versetzte eine kleine Firma die Welt in große Aufregung: Cambridge Analytica hatte eine offene Schnittstelle von Facebook missbraucht, massenhaft Nutzerdaten abgegriffen und die Informationen genutzt, um personalisierte Anzeigen zu schalten. Schnell machten Schauergeschichten die Runde, angeblich habe Trump seinen Wahlsieg der perfiden Manipulation von Cambridge Analytica zu verdanken.

Auf den ersten Blick erinnert Clearview an Cambridge Analytica: Erneut offenbart eine Recherche das fragwürdige Vorgehen eines Unternehmens, das bislang wenig öffentliches Interesse erregt hat. Die Technik dahinter versteht nur ein kleiner Kreis von Menschen. Doch es gibt Unterschiede: Viele der Behauptungen über Cambridge Analytica beruhen auf dem PR-Material der Firma selbst und sind bis heute nicht belegt.

Dagegen kommen in der Recherche über Clearview mehrere Polizeiermittler zu Wort, die bestätigen, wie effektiv die Gesichtserkennung der Firma funktioniert. Das erfolgreichste Marketinginstrument sind demnach kostenlose Testlizenzen. Nach 30 Tagen seien viele Polizeibehörden so überzeugt, dass sie die Software kauften. Clearview scheint also zumindest besser zu funktionieren als alle Gesichtserkennungssysteme, die US-Behörden bislang einsetzen.

Warum ist so eine Datenbank bedenklich?

Die Polizei nutzt Clearview, um Verdächtige zu finden und Verbrechen aufzuklären. Was sinnvoll klingt, birgt Missbrauchspotenzial. Es gibt keine öffentliche Kundenliste, niemand weiß, welche Behörden die Software verwenden. Beamte könnten damit Frauen nachspionieren, Regierungen könnten Dissidenten identifizieren. Wenn Ermittler Fotos hochladen, füttern sie die Datenbank von Clearview - ein System, das nie unabhängig überprüft worden ist. Datenschutz und Absicherung gegen Hacker dürften nicht ganz oben auf der Prioritätenliste gestanden haben.

Clearview selbst scheint wenig Skrupel bei der Auswahl seiner Kunden zu haben. Der NYT zufolge bot das Unternehmen seine Dienste unter anderem dem Republikaner Paul Nehlen an, der offen antisemitische und rassistische Ansichten vertritt. Er könne eine "unkonventionelle Datenbank" nutzen, um Nachforschungen über politische Gegner anzustellen, pries Clearview die Software an.

Was spricht gegen automatisierte Gesichtserkennung?

"Biometrische Gesichtserkennung im öffentlichen Raum, aber auch durch Apps und Geräte gefährdet die Privatsphäre der Bürgerinnen und Bürger", sagt der Bundesdatenschutzbeauftragte Ulrich Kelber. Die Praxis greife tief in die Grundrechte ein. "Wer zum Beispiel bei Demonstrationen befürchten muss, trotz gesetzestreuem Auftreten identifiziert und gespeichert zu werden, der ändert möglicherweise sein Verhalten und geht nicht mehr demonstrieren."

Einerseits gibt es berechtigte Sorgen vor einem flächendecken Netz aus Überwachungskameras, die alle Passanten identifizieren. Andererseits funktionieren die meisten Gesichtserkennungssysteme zumindest im Jahr 2020 nicht perfekt, sondern ausgesprochen unzuverlässig. Wie fast alle Algorithmen übernehmen biometrische Verfahren oft menschliche Vorurteile. Viele Datenbanken werden mit Fotos von weißen Gesichtern gefüttert. Dementsprechend versagen die Systeme bei People of Color oder verdächtigen sie zu Unrecht.

Ist Clearview ein Einzelfall?

Das Ausmaß der Datenbank von Clearview übersteigt bislang bekannte Sammlungen. Es ist aber gut möglich, dass andere Unternehmen oder Staaten längst vergleichbare Systeme aufgebaut haben. Weltweit ist Gesichtserkennung auf dem Vormarsch. Russland identifiziert damit Demonstranten. Pornhub erkennt Darstellerinnen in hochgeladenen Videos. Frankreich will allen Bürgern eine "digitale Identität" geben, die an ihr Gesicht geknüpft ist. Und China lässt nicht nur Uiguren, sondern einen Großteil der Bevölkerung mit Kameras überwachen.

Auch in Deutschland will Innenminister Seehofer die Gesichtserkennung im öffentlichen Raum massiv ausweiten. Ein Gesetzentwurf sieht vor, an 135 deutschen Bahnhöfen und 14 Verkehrsflughäfen Kamerasysteme zu installieren. In den vergangenen Jahren gab es mehrere Pilotprojekte, darunter am Berliner Bahnhof Südkreuz. Die Kameras lieferten allerdings jede Menge Fehlalarme. Experten und Datenschützer halten die Software für ungeeignet, um sie flächendeckend einzusetzen.

Verstößt Clearview gegen die Datenschutzgrundverordnung (DSGVO)?

Biometrische Daten seien personenbezogen und unterstünden damit dem grundsätzlichen Datenverarbeitungsverbot, sagt Nicolas Dumont, Anwalt für Datenschutz bei der Wirtschaftskanzlei Arnold & Porter. Die Betroffenen hätten nicht eingewilligt. Clearview müsse auch keinen Vertrag erfüllen oder lebenswichtige Interessen schützen, deshalb sei kein sogenannter Zulässigkeitstatbestand erfüllt. Dumont glaubt deshalb nicht, dass Clearview in Europa legal agieren könnte. Das deckt sich mit den Einschätzungen von FDP-Politiker Konstantin Kuhle und Juraprofessor Alexander Roßnagel.

Malte Engeler, Datenschutzexperte und Richter am Verwaltungsgericht Schleswig-Holstein, sieht es anders. Er vergleicht Clearview mit einer Suchmaschine wie Google, die ebenfalls öffentliche Informationen auswertet und aufbereitet. "Der Unterschied bei Clearview ist einzig, dass statt eines Wortabgleichs ein Bilderabgleich geschieht, und zwar anhand eines Gesichtserkennungsalgorithmus."

Juristisch relevant sei letztlich nur, wie die Software konkret funktioniere und ob Clearview ein biometrisches Verfahren im Rechtssinne einsetze. Das sei auf Grundlage der bisherigen öffentlich bekannten Informationen aber unklar. "Eindeutig rechtswidrig ist die Nutzung von Clearview durch Private also keineswegs."

Dürften deutsche Behörden Clearview einsetzen?

Auch in dieser Frage sind die Juristen uneins. "Der Einsatz biometrischer Gesichtserkennung fordert eine gesetzliche Ermächtigungsgrundlage, die dem Grundsatz der Verhältnismäßigkeit und dem Bestimmtheitsgebot entsprechen muss", sagt Anwalt Dumont. "Eine generelle Nutzung ist jedenfalls unverhältnismäßig."

Engeler hält es dagegen für möglich, dass sich Strafverfolgungsbehörden eine gesetzliche Grundlage konstruieren könnten: "Ich möchte meine Hand nicht dafür ins Feuer legen, dass die Nutzung von Clearview nicht irgendwo hineingelesen werden kann."

Wie können sich Nutzer wehren?

Das Vorgehen von Clearview zeigt, dass Datenschutz schwierig wird, wenn er nur in der individuellen Verantwortung einzelner Nutzer liegt. Sie erfahren nicht, dass ihre Fotos und Daten abgesaugt werden. Sie können nicht widersprechen, während die Technik tief in ihre Privatsphäre eindringt. Die einzige Möglichkeit zu verhindern, dass Daten analysiert werden, besteht darin, keine Daten zu veröffentlichen. Alles, was frei zugänglich im Netz steht, wird früher oder später ausgewertet - oder ist schon längst von Unternehmen wie Clearview erfasst.

Clearview verstößt mit dem Scraping zwar eindeutig gegen die Nutzungsbedingungen von Plattformen wie Facebook und Twitter. Diese Unternehmen können aber offensichtlich auch nicht verhindern, dass sich Datenstaubsauger die öffentlich zugänglichen Informationen einverleiben, solange es der Gesetzgeber nicht verbietet und die Regeln auch konsequent durchsetzt.