Im Silicon Valley läuft eine Wette um die Zukunft der Welt, und Yann LeCun ist der Mann, auf den Mark Zuckerberg setzt. Wer ihn im New Yorker Facebook-Büro besucht, tippt seinen Namen in ein iPad und wird fünf Minuten später abgeholt. LeCun trägt ein blaues T-Shirt, Hornbrille und spricht Englisch mit französischem Akzent. Fotografieren ist hier verboten, aber das ist eigentlich unnötig: LeCun produziert nichts für Kameralinsen. Seine Forschung soll das soziale Netzwerk komplett umkrempeln und dabei doch unsichtbar bleiben. Er leitet die Abteilung für künstliche Intelligenz (KI).

Nach Jahrzehnten voll enttäuschter Hoffnungen und des stockenden Fortschritts steht LeCun nun an der Spitze einer Bewegung, die viele der Prinzipien, nach denen das moderne Leben organisiert ist, umwerfen könnte: KI wird erwachsen. Algorithmen regieren heute schon in den Alltag vieler Menschen hinein. Sie empfehlen Bücher auf Amazon, Filme auf Netflix, überwachen das Internet, bahnen Beziehungen an.

Seit Jahrzehnten wird an Universitäten künstliche Intelligenz erforscht. Jetzt macht die Disziplin gigantische Sprünge, auch weil mehr Geld im Spiel ist. Viel mehr Geld. Google und Facebook haben den Einsatz auf Hunderte Millionen Dollar erhöht. Das Duell der Datenkonzerne wirkt als Beschleuniger für die Forschung an lernenden Maschinen.

Die Forschung an künstlicher Intelligenz findet heute vor allem in Unternehmen statt und nicht in Universitäten. Ausgerechnet Facebook will das ändern - aus Eigennutz.

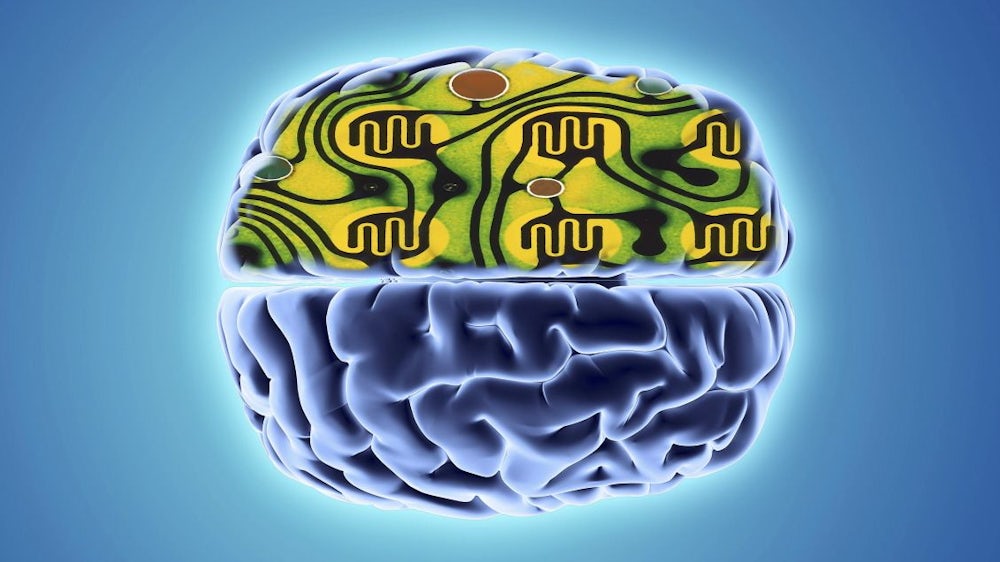

Lernen mit neuronalen Netzwerken

LeCun fängt immer klein an: "Woran wir zur Zeit arbeiten, kann man damit vergleichen, einem Kleinkind ein Buch zu zeigen. Das Kind muss Löwen und Affen erkennen. Die Maschine auch", erklärt er. "Der Unterschied ist, dass Kleinkinder sehen können und Maschinen nicht. Wir müssen ihnen das erst beibringen."

Um Computer sehen zu lehren, setzt das Team von LeCun, 60 Mitarbeiter an drei Standorten, ihnen Bilder vor. Millionen Bilder. Sie sind mit Schlagworten versehen. Auto, Affe, Löwe, Auto. So lange, bis die Computer alleine entscheiden können. Der Lernprozess läuft über ein neuronales Netzwerk, das ist eine Annäherung ans menschliche Hirn und dessen Nervenzellen. Das Netzwerk ist über mehrere Schichten miteinander verbunden, jede verfügt über einige Knotenpunkte.

Je wichtiger eine Verbindung, desto dicker ist sie. Wie hell ist der Gegenstand, ist er eckig oder kantig, wie sind die Proportionen: Von Schicht zu Schicht wird die Analyse detaillierter. "Du zeigst dem System ein Auto und bekommst eine Antwort. Ist sie richtig, bleibt alles unverändert. Wenn die Maschine aber angibt, ein Flugzeug zu erkennen, änderst du die Parameter", fasst LeCun zusammen. Das heißt, die unterschiedlichen Verbindungen innerhalb der Netzwerke werden neu gewichtet. Nach Dutzenden Durchläufen wird der Computer das Auto erkennen - auch dann, wenn es zu großen Teilen mit Schnee bedeckt ist.

Die Maschinen sehen fast so gut wie Menschen. Die Entwicklung ist so vielversprechend, dass Zuckerberg dem Magazin Fast Company sagte: "Eines unserer Ziele ist, (dass die Maschinen) innerhalb der nächsten fünf bis zehn Jahre übermenschliche Fähigkeiten entwickeln." Sehen, hören, verstehen, besser als ein Mensch es jemals könnte. Dafür zu sorgen, das ist, in einem Satz ausgedrückt, LeCuns Job.

Spricht man mit führenden Köpfen aus der Forschung, wird deutlich, dass sie alle eine Überzeugung eint: Es ist nur noch eine Frage der Zeit, bis Maschinen schlauer sind als Menschen.

Wissenschaftler bringen Algorithmen bei, zu malen wie van Gogh oder Munch. Erkennen Sie den Unterschied zwischen Bildern von Mensch und Maschine?

Künstliche Intelligenz ist ein Forschungsbereich, für den nur ein Gesetz zu gelten scheint: Prognosen sagen kaum etwas aus. Ende Januar zeigte sich das eindrucksvoll. Ein Start-up namens Deepmind kreierte einen Algorithmus, der den europäischen Meister im asiatischen Brettspiel Go schlagen konnte, mit 5-0. Allen Prognosen zufolge sollte dieser Moment erst in fünf bis zehn Jahren kommen. Erst dann, so die Überlegung vieler Fachleute, besäßen Maschinen so viel Rechenkraft, um die schiere Anzahl möglicher Spielkombinationen bewältigen zu können. "Bei Go gibt es mehr mögliche Züge als Atome in der Welt" lautet ein PR-Satz des Deepmind-Chefs Demis Hassabis.

Der europäische Meister ist zwar unbedeutend in der Weltrangliste, Platz 633, aber bald wird die KI versuchen, Lee Sedol, einen der besten Spieler der Welt aus Südkorea, zu schlagen. Der Champ sagt, er werde "wenigstens diesmal" noch gewinnen können. Bedeutet wohl: DeepMind hat schon gewonnen. Wenn nicht im März, dann bald.

DeepMind gehört seit 2013 zu Google. Der Kaufpreis betrug mehrere Hundert Millionen Dollar. Das Start-up hatte in einer weiteren Studie Maschinen beigebracht, selbständig diverse Computer-Spiele durchzuzocken. Die KI verließ sich auf Prinzipien des neuronalen Netzwerkes. Hinzu kam jedoch ein weiterer Algorithmus. Die Maschine bekam dabei einen einzigen Input: den Befehl, zu gewinnen. Wie das passieren sollte, also alle Zwischenschritte zum Sieg, fand die Maschine selbst heraus. Nach 600 Versuchen spielte sie übermenschlich gut.

Werden Computer eines Tages den Menschen verdrängen? Ausgerechnet im Silicon Valley macht sich Angst vor den Gefahren der künstlichen Intelligenz breit.

Plattform-Kapitalismus

Pedro Domingos ist Informatik-Professor an der University of Washington und Autor des Buches "Master Algorithm", in dem er die Geschichte des Maschinenlernens nachzeichnet. "Unternehmen wie Google und Facebook stürzen sich darauf, weil es jetzt erst funktioniert. Maschinenlernen ist mächtig, weil Daten mächtig sind", sagt Domingos. Die Zahl der verfügbaren Informationen ist in den vergangenen Jahrzehnten exponentiell gewachsen. Jürgen Schmidhuber, ein bedeutender deutscher KI-Pionier, stimmt Domingos Analyse zu: "Die alten Algorithmen, die wir seit dem letzten Jahrtausend entwickelt haben, haben durch die heutigen viel schnelleren Prozessoren endlich eine Umgebung, in der sie sich entfalten können."

Facebook und Google kommt ihre Stellung als Paradefirmen des Plattform-Kapitalismus zugute. Milliarden Nutzer, nonstop Interaktion in Form von Datenpunkten wie Alter, Geschlecht, Interesse, Aufmerksamkeitsspanne. All das wird in Rechenzentren gespeichert. Die Plattform bringt Nutzer dazu, stets aufmerksam zu sein. Die Datenmenge sorgt für ein besseres Angebot, das wiederum die Datenmenge multipliziert. "Es gibt fünf Datenpools auf der Welt, die groß genug sind, um künstliche Intelligenz daran lernen zu lassen: Yandex, Google, Facebook, Tencent und Alibaba", sagt Chris Boos, Chef des Frankfurter Unternehmens Arago, das KI programmiert, um Unternehmen Routineaufgaben bei der Verwaltung von IT-Technik abzunehmen. Diese Datenpools liegen in Russland, China und in den USA. Nicht in Europa.

Hinzu kommt die Konzentration von Kapital und Programmierertalent, die es den Konzernen ermöglicht, in Bereiche zu investieren, die im Denken der klassischen Industrie keine Rolle spielen. Facebook und Google können sich "Moonshots" leisten - Projekte, die nicht auf kurzfristige Erfolge angelegt sind. DeepMind, heißt es aus der Google-Tochter, müsse aktuell kein Geld verdienen, nicht einmal Googles Anzeigen verbessern, das Geschäft, von dem der Konzern praktisch komplett abhängig ist. Konzernchefs wie Facebooks Mark Zuckerberg oder Googles Sundar Pichai sind keine Sklaven ihrer Aktionäre. Im Gegenteil: Die Aktionäre können froh sein, dass sie dabei sein dürfen.

Die dritte Welle soll alles ändern

Es ist die dritte Welle neuronaler Netze, die das Feld der künstlichen Intelligenz Richtung Mainstream katapultiert. Schon in den 50er- und 80er-Jahren des vergangenen Jahrhunderts wurde versucht, auf diese Netze aufzubauen. Ohne Erfolg. "Die Menschen dachten damals, dass wir atemberaubende Dinge schaffen werden. Aber wir hatten unterschätzt, was für große Datenmengen wir brauchen würden. Das war sehr kleinformatig damals", sagt Geoffrey Hinton im Telefongespräch. Der Mann ist Googles Antwort auf LeCun.

Die beiden kennen sich noch aus der Zeit der "Verschwörung", wie LeCun sie nennt. "2003 haben Geoffrey Hinton, Yoshua Bengio und ich uns getroffen und beschlossen, es noch einmal mit neuronalen Netzwerken zu versuchen." Die drei bewarben sich um Forschungsgelder, organisierten Konferenzen mit Gleichgesinnten. "Von 2010 an hat sich alles zum Guten gewendet. Die Erfolge im Bereich der Spracherkennung waren drastisch", sagt LeCun. Dennoch hat er auch heute noch Angst davor, dass alles nur ein Hype ist. Denn das Wagniskapital fließt. Wurden 2010 noch zehn Millionen US-Dollar in Start-ups für künstliche Intelligenz investiert, waren es 2014 laut Analysten von CB Insights bereits 309 Millionen US-Dollar. Hinton ist optimistisch: "Es ist keine heiße Luft. Wir haben bereits geliefert."

Smarte Algorithmen und selbstfahrende Autos: Googles scheinbar intelligente Technik wird von Menschen trainiert. Von Ihnen, liebe Leser.

Es ist ein sehr spezieller Arbeitsmarkt, bevölkert von den klügsten Informatikern, Mathematikern, ehemaligen Schach-Champions. Nun verändert das Geld, das die Konzerne in das Feld pumpen, auch die universitäre KI-Forschung. Jahrzehntelang war sie ein Biotop der Entwicklungen, wo unangepasste Typen wie Schmidhuber aufblühen konnten. Er hat auch schon Arbeiten zur Algorithmen-Kunst veröffentlicht und spekuliert gerne, dass die Menschen wohl nur ein "Zwischenschritt" in der Evolution seien.

Jetzt muss er sich einer neuen Realität stellen: "Obwohl ich mit knapp 52 Jahren bald meine Midlife-Crisis kriege, muss ich auf meine alten Tage noch Unternehmer werden und raus aus dem akademischen Elfenbeinturm. Ich muss den Mitarbeitern neben der Möglichkeit, im besten Labor zu arbeiten, auch noch Aktienoptionen bieten." Die großen Unternehmen, die jetzt einsteigen, hat er auch schon als "Kannibalen" beschimpft. Guten Studenten, erzählt er, würden "teilweise Ablösesummen im Millionenbereich geboten, ein bisschen wie bei Fußballern".

Künstliche Intelligenz braucht oft noch menschliche Unterstützung. Wie Microsofts Sprachassistentin Cortana zu ihren scherzhaften Antworten kommt.

Computer und Eitelkeiten

Wenn jemand eine Demonstration von Schmidhubers KI-Forschung will, sagt er nur: "Nehmen Sie Ihr Smartphone in die Hand." Die Spracherkennung Google Voice etwa versteht, was der Nutzer will, auch aufgrund ihres sogenannten Long Short Term Memory (LSTM), einer Entwicklung aus Deutschland. "Die haben wir seit 1995 an der TU München und in der Schweiz mit europäischen Steuergeldern entwickelt. Das verwenden jetzt alle, vor allem amerikanische Firmen wie blöd." Ohne seine Forschung wäre Google lange nicht so weit, sagt Schmidhuber.

Überhaupt sprechen die großen Köpfe erstaunlich offen über die Frage: "Wer hat's erfunden?" Apple kaufte in den vergangenen Jahren mehrere Firmen, die an künstlicher Intelligenz arbeiten, aber Facebooks LeCun nimmt den Hardware-Hersteller nicht ernst: "Was die machen, ist keine Forschung", sagt er. "Das ist nur Entwicklung von Technologie." Im Gespräch ist es der einzige Moment, in dem seine Stimme leicht flackert. "Wer forscht, veröffentlicht wissenschaftliche Publikationen, die unabhängig überprüfbar sind", sagt er. Wissenschaft sei mehr als die bloße technische Umsetzung. "Man muss es auch analysieren können. Nur so machen wir Fortschritte." Die Anzahl der Publikationen, die Apple veröffentlicht hat: null. Apple wollte sich auf Nachfrage nicht äußern.

Hinton sagt, ohne das auf einen bestimmten Konkurrenten beziehen zu wollen: "Ich finde es nicht gut, wie sich manche Wettbewerber gegenüber der Forschungs-Community verhalten. Sie verwenden öffentlich zugängliche Forschung und schlagen daraus Profit. Selbst tragen sie aber nichts bei. Wenn das alle so machen würden, wäre es ein Desaster."

Facebook und Google sind dazu übergegangen, Teile ihrer Infrastruktur quelloffen verfügbar zu machen, das bedeutet: Forscher können sie überprüfen und die Systeme nutzen. Die Strategie dahinter erklärt Buchautor Domingos: "Die Konzernen wollen die nächste Stufe der Entwicklung kontrollieren. Sie konkurrieren um Top-Talente. Es ist einfacher, neue Wissenschaftler zu gewinnen, wenn die mit den quelloffenen Produkte vertraut sind."

Für KI-Experten sei es verlockend, nicht nur bei einem namhaften Unternehmen zu arbeiten, sondern gleichzeitig auch die Forschung veröffentlichen zu können. Ausgeschlossen von der Offenherzigkeit sind KI-Systeme, die eng an konkrete Facebook- oder Google-Produkte geknüpft sind. Da geht es dann doch zu sehr ums Geschäft, um die KI-Gemeinde teilhaben zu lassen.

Die Grenzen

Maschinenlernen wird Domingos zufolge eine zentrale Rolle bei der Frage übernehmen, wie die kommende Generation von IT-Systemen aussehen wird. Doch noch gebe es Hürden. Domingos erzählt von einem Kollegen, dessen neuronales Netzwerk lernte, zwischen Hunden und Wölfen zu unterscheiden: "Das klappte sehr gut. Aber dann stellte sich heraus, dass in allen Hundebildern im Hintergrund Schnee zu sehen war - und bei den Wölfen nicht."

Die Maschine hatte also nicht gelernt, wie ein Hund aussah, sondern sich nur den Schnee eingeprägt. Von ähnlichen Problemen berichten andere KI-Forscher: Eine Maschine, die einen Bus korrekt erkennen kann, will plötzlich einen Strauß erkennen, nachdem ein paar Pixel im Bild verändert werden (der Mensch erkennt absolut keinen Unterschied zwischen beiden Bildern).

So richtig verstanden haben KI-Forscher noch immer nicht, wonach ihre Algorithmen urteilen. Aber dank Google und Facebook haben sie jetzt immerhin genug Geld zur Verfügung, um es herauszufinden.