Vor einiger Zeit sandten mehrere Hunderttausend Menschen ihre Selbstbildnisse an einen Online-Schönheitswettbewerb. Warum auch nicht? Doch anstatt wie üblich aus alten Männern bestand diesmal die Jury aus KI - künstlicher Intelligenz. Es sollte der Schönheitswettbewerb sein, der alle anderen Schönheitswettbewerbe deklassiert. Nicht so demütigend wie Miss-Universum-Wahlen, sondern vielmehr objektiv, nüchtern, unparteiisch. Die KI-Software sollte die digitale Entsprechung des Schneewittchen-Spiegels sein. Es gab nur ein Problem: Obwohl die Teilnehmer aus mehr als 100 Ländern stammten, war unter den letztlich 44 Gekürten nur ein Mensch mit dunkler Hautfarbe.

Eine ähnliche Geschichte spielte sich erst in den letzten Wochen auf Facebook ab. Dort konnte man mitverfolgen, wie Freunde ihre Gesichter automatisch von einem KI-Programm namens Face App bearbeiten ließen. Die Bilder ließen sich von jung auf alt oder von männlich auf weiblich verändern. In dieser Version der App gab es auch eine Option namens "hot", man konnte sich von der Software also attraktiv machen lassen. Es gab nur einmal mehr ein Problem: Die Aufhübschungen des Programms verliefen immer gleich. Die Augen wurden ein bisschen runder, der Hautton ein bisschen heller und die Nasen ein bisschen kleiner.

Sowohl die Veranstalter des Schönheitswettbewerbs als auch die Macher der App beteuern nun, dass die Bevorzugung von weißen westlichen Schönheitsidealen keine Absicht war, sondern nur an den Datensammlungen liege, die ihrer Software zugrunde liegen. Es gibt eine ganze Menge solcher Datenpakete. Eines beinhaltet etwa 14 Millionen Bilder von Menschen jeden Alters und jeder Herkunft, ein anderes wiederum 300 000 Fotos von Alltagsgegenständen in ihrem natürlichen Habitat. Tausende Videos, die nur verschiedene Gesichtszüge und Handlungen zeigen. Für die KI-Entwickler ist es logischerweise die primäre Quelle, um ihren Programmen zu zeigen, wie die Welt funktioniert.

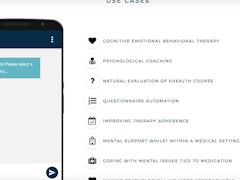

Start-ups basteln Chatprogramme, die als Psychotherapeuten arbeiten sollen. Sie urteilen nicht, haben nie schlechte Laune und immer Sprechstunde.

KI trainiert mit Daten im Netz - und lernt die Vorurteile gleich dazu

Doch egal, ob es um Bilder geht oder um Wörter, Zusammenhänge oder Assoziationen: Das Problem bleibt immer das gleiche. Die vermeintliche Objektivität der Maschinen speist sich aus der Subjektivität der Menschen. Seit beinahe 30 Jahren spült die Menschheit ihr Wissen ins World Wide Web. Wenn KI-Softwares mit diesen Datensammlungen trainiert werden, lernen sie auch die dort vorhandenen Vorurteile und Klischees. Im Fall der Schönheitsprogramme waren es Menschen, die dem Programm vorgegeben haben, dass Weiß schöner zu sein hat als Schwarz. Doch ein Computerprogramm kann eine solche Regel nicht hinterfragen. Wie ein Kind nimmt es sie als gegeben an und fällt entsprechende Urteile.

Es ist ein Problem, das im Übrigen weit davon entfernt ist, nur trivial oder gar theoretisch zu sein. Schon heute bekommen Frauen auf Karriereportalen seltener als Männer Stellenanzeigen für besser dotierte Jobs zu sehen. Weil Weiblichkeit von den Algorithmen eher mit Heim- als mit Erwerbsarbeit assoziiert wird.

Ein weiteres Beispiel sind Berufsbezeichnungen, die in der einen Sprache geschlechtsneutral ausgedrückt werden - sie verändern sich nach einer maschinellen Übersetzung in eine andere Sprache. Aus "er/sie ist ein Arzt/eine Ärztin" und "er/sie ist ein Krankenpfleger/eine Krankenschwester" wird in der Interpretation der Software "er ist ein Arzt" und "sie ist eine Krankenschwester". Unsere intelligenten Maschinen von morgen sind eben genauso rassistisch oder sexistisch, wie es die Menschen schon heute sind.