Man stelle sich einen Menschen vor, der noch nie Musikunterricht hatte. Man zeige ihm ein Klavier, erkläre kurz die Funktion der schwarzen und weißen Tasten und lasse sie oder ihn dann mit dem Instrument alleine. Wenn dieser Mensch nach einer überschaubaren Übungsphase völlig von selbst in der Lage wäre, klassische Sonaten so brillant wie Igor Levit zu spielen und Jazz wie Miles Davis, was würde man von diesem Menschen halten? Das Adjektiv "übermenschlich" wäre zweifellos angebracht.

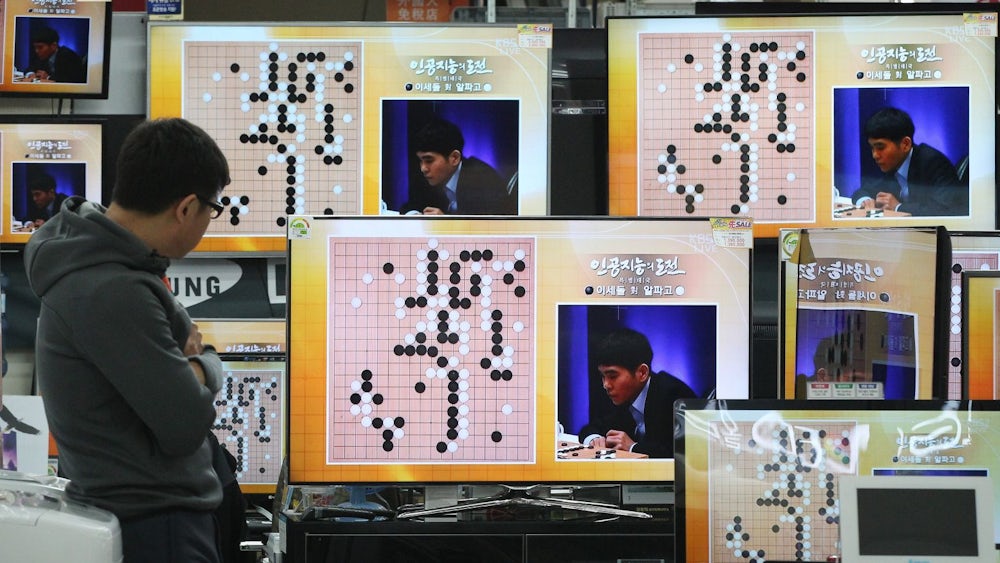

In einer aktuellen Analogie aus der Computerwelt geht es zwar nicht um Musik, sondern um Brettspiele. Und selbstverständlich umfasst die Kunst großer Musiker nicht nur die präzise Abfolge zueinander passender Töne, sondern ein ungeheuerliches Maß an Interpretation, Variation und all das. Doch auch komplexe Brettspiele wie Schach, Go und das hierzulande kaum bekannte Shogi verlangen ihren Großmeistern ein gehöriges Maß an Strategie, Variationskunst und Gespür ab. Nun hat eine selbstlernende Software namens AlphaZero aus der zu Google gehörenden Softwareschmiede DeepMind diese drei hochkomplexen Brettspiele gemeistert - nicht nur besser als jeder lebende Mensch, sondern besser als jeder Computer zuvor (Science). Und das Verblüffende: Die Software hat sich ihre Spielkunst selbst beigebracht.

Kann eine Maschine so gut denken wie ein Mensch? Diese Frage soll der Turing-Test beantworten. Doch mittlerweile zweifeln immer mehr Wissenschaftler an seinem Nutzen.

Es ist die Fortentwicklung der auf neuronalen Netzen basierenden Software AlphaGo, die im Jahr 2016 erstmals jeden menschlichen Go-Spieler überflügelt hat. Damals dienten von Menschen gespielte Partien als Lernmaterial. Im vergangenen Jahr meisterte dann die erste selbstlernende Version von AlphaZero das mathematisch komplexe Go-Spiel. Die neueste Version von AlphaZero ist nun eine selbstlernende Maschine, die Probleme aller Art lösen kann. Die Lernmethode von AlphaZero erinnert an Dr. B. aus Stefan Zweigs Schachnovelle: Der Protagonist beginnt in Isolationshaft, Schach gegen sich selbst zu spielen, linke gegen rechte Gehirnhälfte.

Nach einer nur vierstündigen Lernphase begann AlphaZero, über das beste herkömmliche Schachprogramm der Welt, eine Software namens Stockfish, zu triumphieren. Von hundert Partien gewann AlphaZero 28, der Rest ging unentschieden aus, die neue Software verlor kein einziges Match. AlphaZero besiegte Stockfisch sogar, wenn dem klassischen Programm zehn Mal so viel Zeit zum Nachdenken gewährt wurde. Hierzu muss man sich klarmachen: Menschliche Spieler, auch Weltmeister Magnus Carlsen, haben schon gegen Stockfish nicht die geringste Chance. Carlsens Spielstärke wird derzeit mit 2835 ELO-Punkten bewertet. AlphaZero liegt irgendwo um die 3500 Punkte. Ex-Schachweltmeister Garry Kasparow, der 1997 dem Computerprogramm Deep Blue unterlag und die Übermacht der Maschinen im Schach anerkennen musste, zeigte sich begeistert: "Ich war erfreut zu sehen, dass AlphaZero einen dynamischen, offenen Spielstil zeigte." Bei einer Maschine sei schließlich zu befürchten gewesen, dass sie sich der Perfektion über endloses trockenes Manövrieren annähere. Doch nun zeigte sich: Computerprogramme entwickeln Kampfeslust.

Nach 30 Stunden siegte AlphaZero gegen seinen Vorgänger AlphaGo

Im mathematisch komplexeren Go brauchte AlphaZero immerhin 30 Stunden, um seine eigene Vorgängerversion AlphaGo zu schlagen. Mittlerweile ist AlphaZero in allen drei Spielen unangefochten, auch im hochkomplexen "japanischen Schach" Shogi. Dies gilt unter KI-Forschern als bedeutender Erfolg auf dem Weg zu einer universalen, selbstlernenden Software, die womöglich eines Tages in ganz anderen Lebensbereichen reüssiert, von der Gesundheitsdiagnose bis zum autonomen Fahren.

Dort allerdings sind die Aufgaben nicht so klar umrissen wie auf einem Spielbrett. Philipp Slusallek, der am Deutschen Forschungszentrum für Künstliche Intelligenz in Saarbrücken künstliche Realitäten erforscht, sieht die Simulation realer Umgebungen wie den Straßenverkehr als ungleich aufwändiger und komplexer an als ein Spiel wie Go. Vor allem seien die Spielregeln noch nicht klar umrissen, aus denen sich ein sinnvolles Verhalten der Autos ableiten lasse.

"Begeistert von der neuen Entwicklung AlphaZero" äußerte sich Klaus-Robert Müller, der an der TU Berlin Maschinelles Lernen und Theoretische Informatik lehrt und erforscht. Doch auch er betont, dass eine gänzlich universelle Lernmaschine noch "viele Jahre intensiver Forschung" braucht. Eine Maschine, wie sie eines Tages vielleicht dem Computer HAL aus Stanley Kubricks Film 2001 ähneln könnte.

Interessant an der Entwicklung ist, das die selbstlernende Software auf den scheinbar so überschaubaren Spielbrettern in der Lage ist, ganz neue Wege zu gehen, und Strategien erfolgreich anzuwenden, die menschliche Spieler als aussichtslos oder zutiefst unüblich empfinden. Es zeigt, dass sich noch so schlaue Menschen bei Problemlösungen nur schwer von ausgetretenen Pfaden lösen können.