Was der Mann forderte, schien mehr als bescheiden zu sein: Ein Korn Getreide auf dem ersten Feld eines Schachbretts, zwei auf dem zweiten, vier auf dem dritten, acht auf dem vierten und so weiter - immer doppelt so viel. Das erbat sich nach einer Legende der Erfinder des Spiels von dem indischen Herrscher, dem er es vorführte. Was, so mag der Potentat bei sich gedacht haben, könne am Ende schon herauskommen als ein paar Säcke. Wenn überhaupt.

Wie falsch gedacht!

Auf das letzte, das 64. Feld des Schachbretts würden mehr als neun Trillionen Körner entfallen, aufs gesamte Brett mehr als 18 Trillionen. Sie ergäben einen Berg weit höher als der Mount Everest. Eigentlich war die Forderung also eine Unverschämtheit, sie zu erfüllen unmöglich.

Freie Hardware, heute noch eine Nische, könnte zu etwas sehr Großem werden

Man sollte sich aber hüten, den nasgeführten Herrscher zu belächeln, denn er hat eigentlich nur eine sehr menschliche Eigenschaft gezeigt: Entwicklungen zu begreifen, die immer schneller verlaufen, drastisch, rasend schneller, unfassbar schneller - exponentiell also -, das können Menschen eben sehr schlecht. Daher ist es kaum verwunderlich, wenn die meisten allenfalls dunkel ahnen, dass sich die Welt gerade in einer solchen Entwicklung befindet.

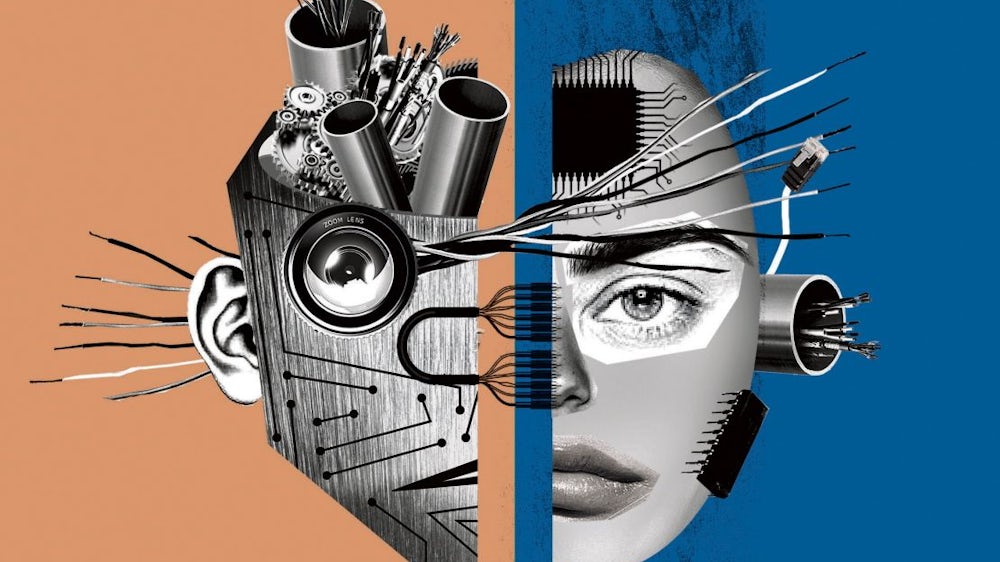

Chips, die kleinen Plättchen aus Silizium, haben die Welt verändert. Ohne sie, ohne Computer, Telekommunikation und Internet läuft heute fast nichts mehr. Ganze Branchen werden umgekrempelt oder verschwinden ganz. Und das geht deshalb so schnell, weil die Entwicklung der Chips ähnlich verläuft wie die Sache mit den Getreidekörnern und dem Schachbrett.

Die Blaupause dafür lieferte Gordon Moore, einer der Mitgründer des Chipherstellers Intel. Im Frühjahr 1965, vor mehr als 50 Jahren also, erschien sein berühmter Aufsatz, in dem er vorhersagte, dass sich die Zahl von Transistoren auf Siliziumchips in regelmäßigen Abständen verdoppeln werde. Und zwar, so die kühne These damals, für die nächsten zehn Jahre. Dass es 50 werden würden und wohl noch ein paar mehr, dass man seine "grobe Schätzung", wie er selber einräumte, Moore's Law nennen würde, Moores Gesetz, das hätte sich Moore nicht im Traum einfallen lassen.

Auf welchem Feld des Schachbretts stehen wir?

Und doch ist es so gekommen. Wer diesen Text zum Beispiel auf einem Smartphone liest, hält den Beweis dafür im Wortsinne in Händen. Ein solches Alleskönner-Handy von heute rechnet nicht nur schneller als die Computerschränke, mit denen die Nasa vor Jahrzehnten die Mondlandung steuerte. Man kann damit auch: Hochauflösende Videos aufzeichnen, Verbindung mit dem Internet aufnehmen, Sexualpartner auswählen, die Position ermitteln und navigieren - die Liste ist schier endlos. Und dabei kostet es nur wenige hundert Euro.

Das ist, wenn man's richtig bedenkt, ziemlich sensationell, und mehr noch, dass fast jeder schon so ein Ding mit sich herumträgt. Viele Branchen spüren immer stärker die Digitalisierung aller Lebensbereiche, doch offen bleibt: Auf welchem Feld des Schachbretts - um das Beispiel aufzugreifen - stehen wir? Und wie lange kann es noch so weitergehen?

Moores Gesetz ist ja kein naturwissenschaftlicher Grundsatz. Es war, glaubt man Leuten aus der Industrie, eher so, dass die Mooreschen Vorhersagen irgendwann zu einem Ziel wurden, das - wenn auch schwer - irgendwie erreicht werden musste. Doch seit einigen Jahren schon gelingt es nicht mehr, die maximale Rechenleistung pro eingesetzter Kilowattstunde weiter derart schnell zu verdoppeln. Statt 18 Monate wie die Jahrzehnte davor dauert es nun 2,7 Jahre.

Das liegt daran, dass man sich bei den Siliziumchips allmählich den Grenzen nähert, die die Physik vorgibt. Die Strukturen auf den Chips werden schon jetzt in Nanometern gemessen. Intel arbeitet an Konzepten für Fünf-Nanometer-Chips, recht viel weiter wird es aber nicht mehr gehen. Und wenn, dann wird es teuer werden.

Aber was dann?

Wird es doch nichts mit der sogenannten Singularität, daraus also, dass Maschinen - wie einige Forscher glauben - wegen der immensen Steigerung der Rechenleistung in wenigen Jahrzehnten derart intelligent werden, dass nicht mehr vorherzusehen sei, was dann passiert?

Das ist womöglich die falsche Frage. Denn schon heute laufen die Hochleistungschips in unseren Laptops und Smartphones 99 Prozent der Zeit im Leerlauf. Verbesserungen bei der Energieeffizienz, argumentiert daher der amerikanische Forscher Jonathan Koomey, könnten die Zeit überbrücken, bis fundamental neue Computer-Konzepte marktreif seien.

Davon gibt es einige. Vor wenigen Tagen erst meldete der Internet-Konzern Google Erfolge mit einem Quantencomputer - bestimmte Berechnungen, wie etwa die, die man zum Knacken von Verschlüsselungen braucht, könnten damit um Dimensionen schneller ausgeführt werden. Forscher überlegen daher bereits jetzt, wie sie Daten auch künftig noch sicher verschlüsseln können.

In anderen Projekten geht es darum, die Speichertechnologie zu verbessern. Wenn es endlich klappt mit der neuen Technik, könnten auf Handys ganze Filmbibliotheken abgelegt werden, und alle Daten, die in solchen Modulen gespeichert sind, könnten rasend schnell zur Verarbeitung im Prozessor geschickt werden. Der Computerkonzern HP zum Beispiel arbeitet an einem solchen Speicher und dazu an einem völlig neuen Rechner-Aufbau samt neuem Betriebssystem.

In einer Zeit, in der die Menge der Daten schneller wächst als die Kapazität der Chips, sie zu berechnen, könnte gerade das wichtig werden. Etwa 90 Prozent aller Daten, die heute auf Computern gespeichert sind, wurden erst in den vergangenen beiden Jahren erzeugt. Mit den zahllosen Sensoren im Internet der Dinge, von Fitness-Armbändern über automatisierte Fabriken bis hin zu Vibrationssensoren in Autobahnbrücken, wird sich diese Entwicklung noch steigern - und zwar auch immer schneller. Dazu kommt: Mehr Daten, die bisher noch nicht oder nicht richtig genutzt werden, werden auswertbar sein. Entweder weil sie in einer für Computer besser lesbaren Form gespeichert werden oder aber, weil Computer immer besser lernen, auch aus Texten, aus Einträgen in sozialen Netzwerken, ja sogar aus Bildern Informationen zu destillieren.

Dass es dabei künftig nicht mehr funktionieren wird, einfach auf die nächste Verdopplung der Rechenkapazität zu setzen, muss kein Nachteil sein, ist zum Beispiel der Elektronik-Entwickler Andrew Huang überzeugt. "Selbst wenn Moores Gesetz bald oder abrupt endet, sollten die Chipentwickler und die Verbraucher lernen, ihre Angst zu besiegen und sich darauf zu freuen, was noch kommt", schrieb er zum 50. Jahrestag von Moores Gesetz. Das könnte, so glaubt zumindest er, eine Bewegung sein ähnlich der, die heute Software wie Linux oder den Browser Firefox programmiert. Freie Hardware, heute eine absolute Nischenangelegenheit im Schatten von Giganten wie Intel oder Samsung, könnte zu etwas sehr Großem werden.