Sarah und Tim leben in einer gefährlichen Parallelwelt. Wenn sie sich treffen, radikalisieren sie sich sofort. Die Themen sind immer dieselben, das Feindbild ist eindeutig. Andere Meinungen spielen in ihrer Filterblase keine Rolle, unter Ausschluss der Öffentlichkeit wird geschimpft und gehetzt.

Die Filterblase von Sarah und Tim hat nichts mit Facebook zu tun. Flüchtlinge spielen bei ihren Treffen keine Rolle. Die beiden sind Fans von 1860 München, gehen zusammen ins Stadion oder in die Kneipe, um ihrer Mannschaft beim Verlieren zuzuschauen. Schuld sind fast immer die anderen: die Gegner, der Schiri, die Bayern.

Trotzdem kommt niemand auf die Idee, vor dem Stadion oder der Kneipe zu warnen - auch wenn sich dort besonnene Studenten in grölende Wutbürger verwandeln. Vor Facebook wird dagegen täglich gewarnt. Das soziale Netzwerk gefährde die Demokratie, weil es seinen bald zwei Milliarden Nutzern nur Inhalte anzeige, die deren politische Meinungen bestätigen. Schuld sei "der Facebook-Algorithmus".

So geht, leicht zugespitzt, das Filterblasen-Lamento, das Journalisten und Politiker gerne anstimmen. Nicht jeder Ton des Lieds ist schief, aber die Platte hat einen Sprung: Seit Jahren hört sich ein Großteil der Kritik gleich an, sie ignoriert aktuelle Forschungsergebnisse und blendet aus, dass Menschen auch in prädigitalen Zeiten dazu neigten, sich mit Gleichgesinnten zu umgeben. Das ist schade, denn Facebook hat sehr wohl eine Verantwortung, und Algorithmen können gefährlich werden. Doch um diese Entwicklung zu beleuchten und zu hinterfragen, braucht es nicht mehr Dystopie, sondern mehr Differenzierung.

"Die Angst vor der Filterbubble halte ich für übertrieben"

Die wünscht sich auch Eli Pariser. Mit seinem Buch "The Filter Bubble" hat der Journalist und Autor vor sechs Jahren den Begriff geprägt, den Kulturpessimisten beim zweiten Glas Rotwein heute mit derselben Zwangsläufigkeit hervorholen wie Kommentatoren in Online-Foren den Hitlervergleich. "Wir sollten den Einfluss der sozialen Netzwerke nicht überbewerten", sagt Pariser. "Menschen bilden sich ihre Meinung ja nicht nur auf Facebook. Im Gegenteil: Klassische Medien sind immer noch deutlich wichtiger." Das trifft auch für Deutschland zu: Fast drei Viertel schauen regelmäßig Nachrichten im klassischen Fernsehen, weniger als ein Drittel nutzt dafür soziale Netzwerke ( PDF).

Sascha Hölig ist Medienforscher beim Hans-Bredow-Institut, das diese Zahlen erhoben hat. Er stimmt Pariser zu: Zwar steige die Zahl der Menschen, die Nachrichten über Facebook konsumierten, doch nur für einen verschwindend geringen Anteil seien soziale Medien die wichtigste Nachrichtenquelle. "Die Angst vor der Filterbubble halte ich deshalb für übertrieben", sagte Hölig der dpa.

Eine aktuelle Studie des Forschungsinstituts National Bureau of Economic Research ( PDF) bestätigt diese Einschätzung. Die Autoren haben untersucht, welche gesellschaftlichen Gruppen sich in den USA zwischen 1996 und 2012 am stärksten polarisiert haben. Ihr Ergebnis: Die Alten driften ideologisch deutlich stärker auseinander als die Jungen. Anders ausgedrückt: Der politische Graben öffnet sich in jener Altersgruppe am weitesten, in der am wenigsten Menschen aktiv soziale Medien nutzen.

Soziale Medien sind nicht schuld an gesellschaftlicher Polarisierung

Als Kriterien haben die Forscher neun Faktoren zugrunde gelegt. Dazu gehört zum Beispiel, wie man Mitglieder der anderen Partei wahrnimmt und ob man bei Präsidentschafts- und Senatswahlen jeweils Mitglieder derselben Partei wählt. Bei acht von neun Faktoren ist die Polarisierung bei den Über-75-Jährigen deutlich ausgeprägter als bei den Teilnehmern zwischen 18 und 39 Jahren.

Ezra Klein, Chefredakteur von Vox.com, fragt deshalb: "Falls Facebook das Problem ist, wie kann es dann sein, dass dieses Problem am deutlichsten bei Menschen auftritt, die Facebook gar nicht nutzen?" Levi Boxell, einer der beteiligten Wissenschaftler, nimmt Facebook mit Blick auf die zunehmende Polarisierung der amerikanischen Gesellschaft aus der Schusslinie: "Wenn man sich die Daten anschaut, ist es schwer, eine Geschichte zu konstruieren, in der das Internet und soziale Netzwerke die Hauptrolle spielen."

Klar ist aber auch, dass die Studie nicht als Blankoscheck für Facebook taugt. Der Untersuchungszeitraum endet 2012 - nur ein Jahr nach Parisers Buch, zu einem Zeitpunkt, als die Personalisierung des Webs gerade erst begonnen hatte. Boxell hält das für einen validen Kritikpunkt, weist aber auch daraufhin, dass die amerikanische Gesellschaft bereits seit zwei Jahrzehnten auseinanderdrifte, also deutlich länger, als etwa Facebook existiert. Deshalb lehnt er es ab, soziale Medien für diese Entwicklung hauptverantwortlich zu machen.

Es gibt kaum aussagekräftige Studien über Facebooks Filterblase

Fast alle aktuellen Studien, die untersuchen, inwieweit Facebooks Algorithmen das Weltbild seiner Nutzer beeinflussen, haben Schwächen. Einige beruhen auf veralteten oder unvollständigen Daten, teilweise fehlen Kontrollgruppen. Vor zwei Jahren veröffentlichte Facebook selbst eine Untersuchung im renommierten Fachblatt Science. Fazit der Wissenschaftler: Die Filterblase ist längst nicht so dicht wie gemeinhin angenommen, der Einfluss der Algorithmen geringer als befürchtet.

Doch auch diese Studie zeichnet ein unvollständiges Bild. Als Grundgesamtheit dienten nicht etwa alle Facebook-Nutzer, sondern nur jene, die sich selbst in ihrem Profil als "liberal" oder "konservativ" verorten - also nur ein Bruchteil, und erst recht kein repräsentativer.

Flüchtlingsdebatte, Trump, AfD: Facebook verändert die Politik radikal. Fünf Gründe, warum sich der Kampf um Stimmen und Meinungen grundlegend gewandelt hat.

Zweifel gibt es auch an der Interpretation, die von den beteiligten Facebook-Wissenschaftlern mitgeliefert wurde: Filterblasen entstünden in erster Linie aufgrund individueller Entscheidungen, etwa der Auswahl der Freunde oder den Likes und Klicks eines Nutzers. Algorithmen seien vergleichsweise unwichtig. Diese Aussage trifft zwar zu, die Soziologin Zeynep Tufekci nennt sie aber "die schlimmste Gegenüberstellung von Äpfeln und Birnen, die ich je gesehen habe". Tatsächlich verstärkten sich beide Effekte gegenseitig, sodass sich der Einfluss der Algorithmen nicht durch den Verweis auf andere, schwerwiegendere Faktoren relativieren lasse. Mehrere renommierte Kommunikations- und Sozialwissenschaftler schlossen sich der Kritik an der Studie an.

Eli Pariser warnt vor Verdummung

Auch Eli Pariser hält die Studie nicht für geeignet, um die Luft aus seiner Filterblasen-Theorie zu lassen. Tatsachlich habe die Untersuchung einen signifikanten Einfluss von Algorithmen gemessen. Facebooks Filter führen dazu, dass Nutzer im Durchschnitt sechs Prozent weniger Inhalte angezeigt bekommen, die ihrer Weltanschauung zuwiderlaufen. Das sei zwar weniger, als er selbst vermutet hätte, aber eben auch kein Grund zur Entwarnung.

Zumal Pariser nicht nur politische Polarisierung befürchtet, sondern auch Verdummung. Kurz gefasst geht seine Argumentation so: Facebook will Geld verdienen. Je länger Nutzer auf Facebook klicken und wischen, desto mehr Anzeigen sehen sie, desto mehr Geld verdient das Unternehmen. Also versucht Facebook, seine Mitglieder lange auf der Plattform zu halten und zeigt ihnen möglichst interessante Inhalte an. Die meisten Menschen interessieren sich kaum für Politik, entsprechenden Links folgen sie nur selten. Das registrieren Facebooks Algorithmen und bevorzugen Hochzeitsfotos und Katzenvideos gegenüber harten Nachrichten.

Filter sind notwendig: Die Menge der verfügbaren und potenziell relevanten Informationen wächst stetig, und niemand kann das ganze Internet oder auch nur das halbe Facebook lesen. Algorithmen können helfen, eine Vorauswahl zu treffen. Ob daraus gefährliche Filterblasen werden, liegt in den Händen mehrerer gesellschaftlicher Gruppen: Nutzern, Medien und nicht zuletzt Facebook selbst.

Was Nutzer tun können: Fürchtet euch nicht

Menschen fürchten sich vor Dingen, die ihnen fremd sind. Nur wenige Menschen verstehen etwas von Algorithmen, dementsprechend lösen diese bei vielen Besorgnis aus. Dafür gibt es eigentlich keinen Grund. Algorithmen sind nur aneinandergereihte Handlungsanweisungen an ein Computerprogramm. Sie denken nicht selbst, entwickeln kein Eigenleben und spiegeln höchstens Vorurteile und Weltanschauung ihrer menschlichen Schöpfer wider.

Statt Angst vor der Macht des ominösen Facebook-Algorithmus zu haben, sollten Nutzer versuchen, dessen Funktionsweise zu verstehen. Leider verrät Facebook keine Details, dennoch kann man durch bewusstes Liken und Interagieren mit bestimmten Inhalten seinen Newsfeed gewissermaßen trainieren. Jeder Klick ist für Facebook ein Signal für Relevanz und erhöht die Chance, in Zukunft ähnliche Posts und Links angezeigt zu bekommen.

Was Medien tun können: Blasen platzen lassen

Das Naheliegende: Medien können Leser kritisch und fundiert über Algorithmen aufklären, ohne Panik zu verbreiten. Noch wichtiger: Sie sollten darauf achten, sich nicht selbst in Filterblasen zu verstricken. Digital, aber auch und vor allem im analogen Berufsleben. Viele Journalisten leben in Großstädten und sind bestens darüber informiert, wie Akademiker in Schwabing, Kreuzberg und auf der Hamburger Schanze denken - mit den Menschen auf dem Land kommen die meisten eher selten in Kontakt.

Der amerikanische Datenjournalist Nate Silver nennt das die " Liberal Media Bubble". Sie führte in den USA dazu, dass Journalisten Donald Trump keine Chancen einräumten und vom Ergebnis der Präsidentschaftswahl schockiert waren. Je mehr Lokal- und Regionalzeitungen sterben, desto drastischer wird dieser Effekt. In Deutschland ist es noch nicht so weit, aber die Entwicklung geht in dieselbe Richtung. München, Berlin und Hamburg sind großartige Städte, aber ein Großteil der Bevölkerung lebt woanders. Teilweise findet man diese Menschen auf Facebook, teilweise müssen Reporter öfter weiter weg von ihrer Redaktion recherchieren.

Was Facebook tun kann: Mitspracherecht für Nutzer

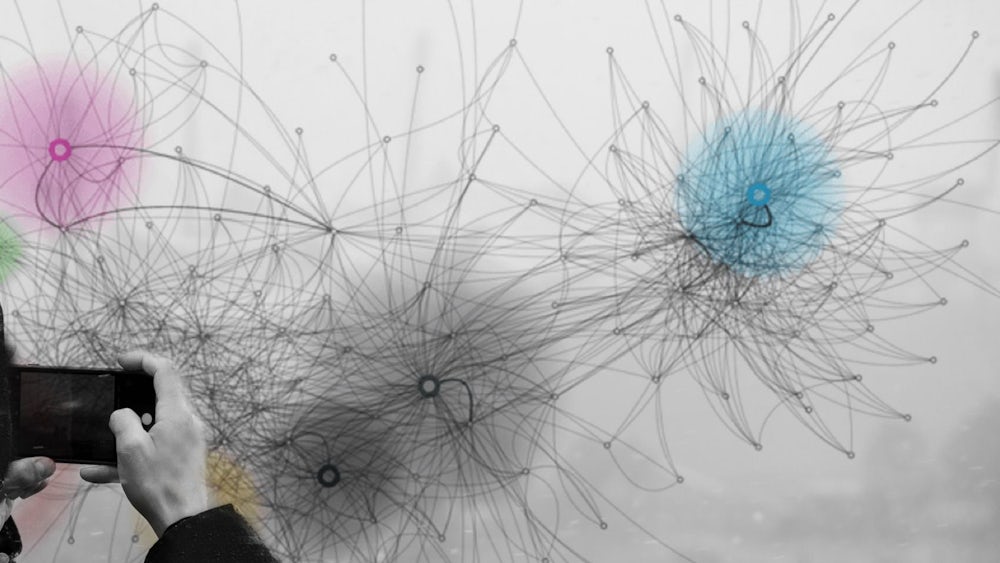

Auch bei Facebook selbst gibt es keinen Mitarbeiter, der exakt weiß, wie der Algorithmus funktioniert. Tatsächlich ist "der Facebook-Algorithmus" ein komplexes Zusammenspiel aus vielen tausend unterschiedlichen Kriterien und Signalen, an dem Hunderte talentierte Programmierer mitgeschrieben haben. Genauso wenig wie Google jemals seinen kompletten Suchalgorithmus offenlegen dürfte, wird sich Facebook für Nutzer und potenzielle Konkurrenten nackig machen. Dass deutsche und europäische Digitalpolitiker ihren entsprechenden Forderungen mit schmerzhaften Konsequenzen Nachdruck verleihen, müssen die kalifornischen Konzerne aktuell nicht befürchten.

In dieser Hinsicht gleicht Facebook Unternehmen wie Coca-Cola: Beide hüten ihr Erfolgsrezept. Im Unterschied zu Facebook hat die Zusammensetzung eines Softgetränks allerdings wenig Auswirkung auf die politische Meinungsbildung von Milliarden Menschen. Schon lange ist das Netzwerk keine neutrale Plattform mehr, die lediglich nutzergenerierte Inhalte darstellt. Facebooks Algorithmen gewichten, sortieren und beeinflussen damit das Weltbild der Nutzer. Der Effekt mag weniger stark sein als befürchtet, aber er ist messbar und wird zunehmen, je weiter Facebook wächst.

Es geht nicht darum, dass Facebook entscheidet, was gut oder schlecht, wahr oder falsch ist. Ein erster Schritt könnte es sein, Nutzern besser zu erklären, wie der Newsfeed funktioniert. Warum sehe ich das Hochzeitsfoto meiner alten Schulfreundin, nicht aber den letzten Link, den mein Kollege gepostet hat? Nutzer müssen wissen, nach welchen Kriterien Algorithmen entscheiden. Dann können sie auch Einfluss auf die Software nehmen.

Adam Mosseri, Produktverantwortlicher für den Newsfeed, sagt, dass Facebook im kommenden Jahr transparenter werden und Nutzern mehr Einblicke geben möchte. Bislang sind es nur vage Willensbekundungen, aber noch vor kurzem wäre eine solche Ankündigung kaum vorstellbar gewesen. Vielleicht bekommt Zeynep Tufekci ja doch noch, was sie sich schon 2015 wünschte - die Möglichkeit, dem Newsfeed-Algorithmus zu sagen: "Bitte zeige mir mehr Inhalte, die nicht meiner Meinung entsprechen".