Frank Pasquale ist Jura-Professor an der University of Maryland. Am Dienstag wird er auf einer Konferenz an der Forschungsstelle Internet und Menschenrechte in Berlin über die "Ethik der Algorithmen" reden. In seinem Buch "Black Box Society" befasst er sich damit, wie Algorithmen von Unternehmen eingesetzt werden - und was getan werden muss, damit Nutzer stärker mitreden können.

SZ.de: Herr Pasquale, Sie haben Ihr Buch "Black Box Society" genannt. Warum?

Frank Pasquale: Dafür gibt es zwei Gründe. Da ist zuerst einmal der Begriff, so wie wir ihn heute gebrauchen. Jedes Flugzeug hat eine Black Box. Kommt es zu einem Crash, gehört die Box zu den wichtigsten Gegenständen, denn sie zeichnet immense Datenmengen auf. 90 Prozent aller Autos in den USA haben eine solche Black Box.

Auch Start-ups und ihre Entwickler nutzen so ein System. Sie bekommen Datensätze von uns und arbeiten damit. Aber wir erfahren nicht, was mit den Daten passiert. Das ist der zweite Grund - und das, was ich meine, wenn ich von einer Black Box rede.

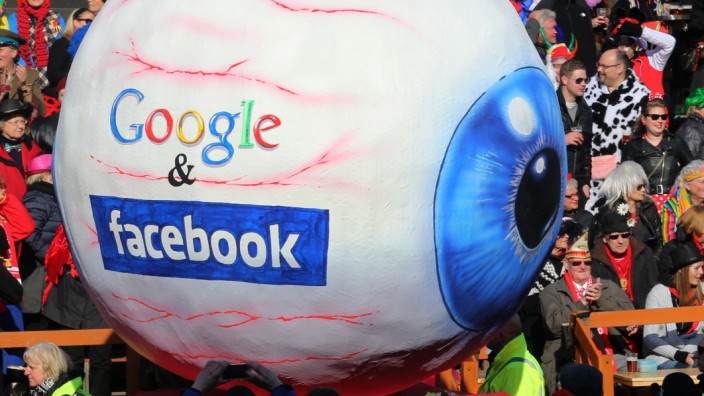

In Ihrem Buch kritisieren Sie vor allem zwei Bereiche: Werbetreibende und Unternehmen wie Google oder Facebook.

Wir reden hier von Unternehmen, deren Entscheidungen Hunderte Millionen Menschen betreffen. Es geht für diese Unternehmen um viel Geld. Das verdienen sie mit Algorithmen, in denen unsere Informationen enthalten sind. Die Algorithmen aber sind geheim. Wir können so gut wie nichts dagegen tun.

Eine Frau, die ihren eigenen Vornamen gegoogelt hat, bekam in den Werbeanzeigen über den Ergebnissen eine Frage gestellt: "Verhaftet?". Sie hat in einer Studie überprüft, ob es einen Bezug zwischen Namen und Werbung gibt und kam zu dem Schluss, dass Google-Suchen nach klassisch afrikanisch-amerikanischen Namen zu negativeren Werbungen führten.

Der Algorithmus ist also rassistisch programmiert?

Das wissen wir nicht. Google hat das kategorisch dementiert. Es sind viele Modelle denkbar, die zu so einem Ergebnis führen könnten. Wir können nur mutmaßen - und das ist ein Problem. Ein weiteres Beispiel: Als in Ferguson ein schwarzer Jugendlicher von einem weißen Polizisten erschossen wurde, dominierte dieses Thema Twitter. Auf Facebook war das Thema aber überhaupt nicht präsent. Das beeinflusst direkt, wie Menschen ihre Welt wahrnehmen.

Das liegt daran, dass Twitter sich auf das konzentriert, was gerade jetzt passiert und damit ein Echtzeit-Medium ist. Facebook hingegen analysiert, ob Menschen über ein Thema reden. Die Verzögerung ist also gewollt.

Ja, aber wir können uns ohne größere Probleme eine Welt vorstellen, in der Facebook Twitter aufkauft. Das war zumindest mal im Gespräch. Twitter übernimmt die Algorithmen von Facebook - und filtert negative Nachrichten fortan stärker. Vor allem bei Facebook reden wir von einem Unternehmen, das gewisse Handlungen belohnt. Nehmen wir Emerson Spartz ...

... den Unternehmer, der vor allem Geld damit macht, Schlagzeilen generieren zu lassen, die beim Leser gut ankommen sollen, aber im Zweifel übertrieben sind, und damit unwahr.

Genau. Dafür hat sich der Begriff "Clickbait" eingebürgert. Spartz selbst sagt, dass er ohne Facebook niemals so erfolgreich wäre. Er sagt auch, dass positive Geschichten sich stärker verbreiten als negative. Sein Unternehmen hat einen Algorithmus entwickelt, der analysiert, welche Überschriften auf Facebook wie gut geklickt werden. Für Nutzer ist das, was sie zu sehen bekommen, absolut nicht nachvollziehbar. Mich besorgt das.

Politische Kampagnen und die Zerschlagung von Google

In Ihrem Buch schreiben Sie, dass politische Kampagnen immer mehr dem Vorgehen von Werbetreibenden ähneln. Können Sie ein Beispiel nennen?

Wenn Politiker Big-Data-Analysen nutzen, um damit eine Wahlkampagne zu fahren, gibt es immense Anreize für Manipulation. Zielgenaue Werbung macht das möglich. Ein Beispiel: Ein Kandidat schaltet eine Annonce, die speziell an Senioren gerichtet ist und eine andere, die sich an jüngere Wähler richtet. Inhaltlich widersprechen sich beide. Doch weil die eine nur die jungen, die andere nur die älteren Menschen sehen, fällt es nicht auf. Es gibt zurzeit keinen gesetzlichen Weg, das zu unterbinden.

Werbetreibende handeln ähnlich: Sie gehen so weit, Bilder von Menschen zu suchen, die so ähnlich aussehen wie ich. Wenn ich die Werbung sehe, so die Hoffnung, steigt damit die Wahrscheinlichkeit, dass ich das Produkt auch kaufe.

Aber ist das nicht genau das Ziel von Werbung an sich? Dort werden auch Menschen abgebildet, die das klassische Zielpublikum sein sollen.

Schon, aber ich glaube, wir müssen von einer neuen Qualität ausgehen. Marketing-Unternehmen raten in ihren Berichten mittlerweile dazu, Frauen zu jenen Zeiten mit Werbung zu konfrontieren, in denen sie sich am unwohlsten fühlen. Das ist einfach zu detailliert. Das ist Manipulation.

In Deutschland wird gerade diskutiert, ob Google zerschlagen werden muss. Wie sehen Sie das?

Auf diese Art würde man den kompletten Service, den Google bietet, beenden. Das Datensammeln an sich zu verhindern, kann also keine Lösung sein. Die wichtige Frage ist: Wie können wir die Firma regulieren?

Und, wie können wir das?

Klassischerweise würde man sagen: Es gibt fünf Suchmaschinen mit fünf Nutzergruppen. Aber das wird nicht passieren. Die digitale Welt ist eine der Monumental-Unternehmen. Wir müssen also Giganten regulieren.

"Google ist nur deshalb so gut, weil es keine Gegner gibt"

Wie genau würde das aussehen?

Unternehmen, die mit Daten handeln, dürfen das nur dann tun, wenn sie sowohl der Regulierungsbehörde als auch den Nutzern mitteilen, woher die Daten kommen und an wen sie verkauft werden. Wir müssen erfahren, was diese Unternehmen über uns wissen. Nur so können wir beurteilen, ob es sich für uns lohnt, ein Netzwerk zu benutzen. Das gilt auch für Facebook. Den Nutzern muss transparenter kommuniziert werden, warum etwas angezeigt wird und warum nicht.

Die digitale Welt befindet sich im Wandel. Firmen, die vor ein paar Jahren als unfassbar groß galten, existieren heute nicht mehr. Ist es nicht denkbar, dass Google ein ähnliches Schicksal ereilt?

Das höre ich nun seit zehn Jahren. Manche glauben, dass die Ökonomie fair sei und diejenigen belohne, die hart genug arbeiten. In jeder Garage könne der Computer stehen, auf dem das nächste Großprojekt erfunden wird. Die Wahrheit ist: Google hat Millionen dieser Computer. Google ist alternativlos. Das Unternehmen benutzt seine Kundschaft.

Wie meinen Sie das?

Google ist nur deswegen so gut, weil es keine echten Gegner gibt und wir alle gemeinsam mitmachen. Jede Suchanfrage von uns macht den Dienst besser. Was die Nutzer leisten, in Form von Suchanfragen, das ist klassische Arbeit. Dadurch entsteht eine kollektive Intelligenz, die wir Google nennen. Aber das Geld, das dadurch entsteht, bekommen wir nicht. Das kriegen die Investoren. Google sollte seinen Nutzern Geld zahlen.